"이 가설, 2015년에 포기한 건데 AI가 다시 꺼내들었습니다." 한 연구자가 Hacker News 댓글에 남긴 말이다.

지난주 Hacker News에 올라온 'Autoresearch on an old research idea'라는 게시글이 연구자 커뮤니티를 뒤흔들었다. 한 사용자가 10년 전 중단한 연구 가설을 AI 자동화 도구 'Autoresearch'에 입력했다. 도구는 관련 문헌을 수집하고, 가설의 논리적 정합성을 검증하고, 실험 설계 초안까지 생성했다. 그 전 과정을 공유하자 댓글 창은 순식간에 수백 개의 반응으로 채워졌다. 놀라움, 회의, 그리고 약간의 두려움이 뒤섞인 반응들이었다.

AI가 코드를 짜고, 이미지를 그리고, 문서를 요약하는 건 이제 뉴스가 아니다. 그런데 과학 연구 자체를 자동화한다? 차원이 다른 얘기다.

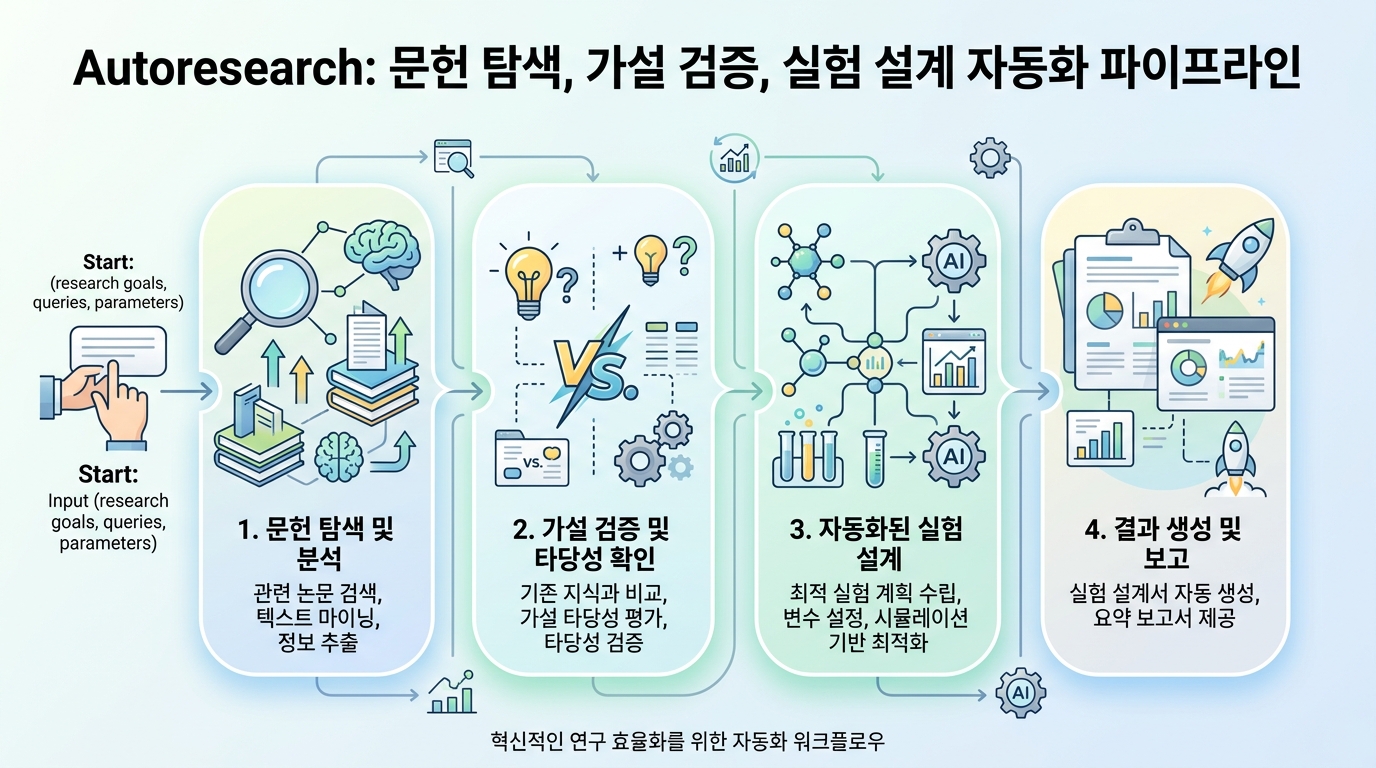

수주 걸리던 작업을 수 시간 만에: Autoresearch의 작동 원리

Autoresearch의 작동 방식은 단순하지 않다. 사용자가 연구 가설이나 질문을 입력하면, 시스템은 여러 단계를 순차적으로 밟는다. 먼저 대규모 학술 데이터베이스에서 관련 논문을 수집하고 분류한다. 단순 키워드 매칭이 아니다. 논문 간 인용 관계와 방법론적 유사성까지 분석해 핵심 문헌을 추려낸다.

그다음이 핵심이다. 수집된 문헌을 바탕으로 가설의 논리적 구조를 평가하고, 기존 연구와의 충돌 지점이나 미탐색 영역을 식별한다. Hacker News 원문에 따르면, AI는 10년 전 해당 가설이 왜 폐기됐는지를 추적했고, 그 사이 축적된 새로운 실험 데이터와 방법론이 당시의 한계를 우회할 수 있다는 점을 포착했다. 결과적으로 "이 가설은 재검토할 가치가 있다"는 판단과 함께 구체적인 실험 설계 초안을 제시했다.

사람이 같은 작업을 하면 수주에서 수개월이 걸린다. Autoresearch는 몇 시간 만에 해냈다. 최종 판단은 여전히 사람의 몫이지만, '첫 삽을 뜨는' 속도가 근본적으로 달라진 셈이다.

과학의 다크매터: 서랍 속에 잠든 가설들

이 사례가 특히 큰 반향을 일으킨 데는 이유가 있다. 과학 연구에는 '서랍 속 가설(drawer hypotheses)'이라 불리는 것들이 무수히 존재한다. 이론적으로는 그럴듯하지만, 당시 기술적 한계나 연구비 부족, 혹은 단순히 트렌드에서 밀려 검증되지 못한 채 묻힌 아이디어들이다.

학술 출판의 구조적 편향도 한몫한다. 긍정적 결과(positive results)만 저널에 실리기 쉬운 탓에, 부정적 결과나 미완의 가설은 체계적으로 매몰된다. 한 HN 댓글 작성자는 이를 "과학의 다크매터"라 표현했다. 존재하지만 아무도 들여다보지 않는 것들.

Autoresearch 같은 도구가 의미를 갖는 건 바로 이 지점이다. AI는 경력 인센티브나 학계 정치에 구애받지 않는다. "유행하는 주제"가 아니라 "논리적으로 탐색할 가치가 있는 주제"를 편향 없이 찾아낼 수 있다. 적어도 이론적으로는 그렇다.

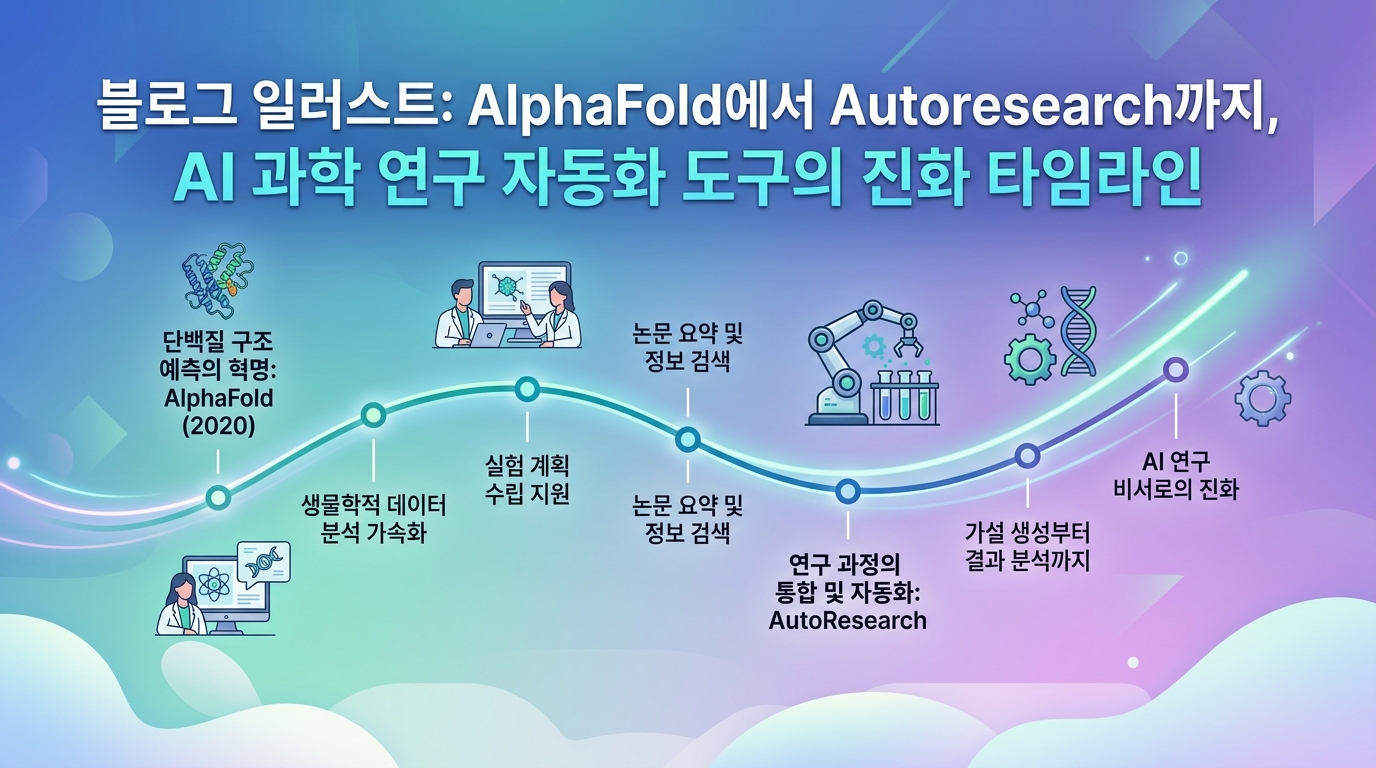

AlphaFold에서 Autoresearch까지: '연구 보조'를 넘어 '연구 파트너'로

Autoresearch가 갑자기 등장한 건 아니다. AI를 활용한 과학 연구 지원은 이미 여러 갈래로 진행돼 왔다.

Google DeepMind의 AlphaFold는 단백질 구조 예측이라는 생물학의 오랜 난제를 풀었고, 2024년 노벨 화학상의 근거가 됐다. Meta의 Galactica는 과학 문헌 처리에 특화된 대형 언어모델로 출발했으나, 허위 정보 생성 논란으로 공개 3일 만에 내려졌다. Elicit, Semantic Scholar 같은 도구들은 논문 탐색과 요약을 자동화하며 연구자들의 일상에 스며들었다.

그러나 Autoresearch가 보여준 것은 이들과 결이 다르다. 문헌 검색이나 요약에 머무르지 않고, 가설의 타당성 평가와 실험 설계라는 연구의 핵심 지적 작업(core intellectual work)까지 자동화 영역에 끌어들였다. '연구 보조'가 아니라 '연구 파트너'에 가깝다.

환각이 만든 가설에 수억 원을 걸 수 있는가

HN 토론에서 가장 뜨거웠던 쟁점은 명확하다. AI가 생성한 가설과 실험 설계를 얼마나 신뢰할 수 있는가.

긍정론자들의 논거는 실용적이다. 연구자 한 명이 읽을 수 있는 논문 수에는 물리적 한계가 있다. 매년 500만 편 이상의 학술 논문이 쏟아지는 시대에, 인간의 문헌 조사에는 구조적 사각지대가 생길 수밖에 없다. AI는 이 사각지대를 메운다. 특히 학제간(interdisciplinary) 연결 고리를 발견하는 데 탁월하다. 생물학 가설에 물리학 방법론을 연결하는 식의 조합은, 분야에 매몰된 전문가보다 AI가 더 잘해낼 수 있다는 것이다.

회의론자들의 우려도 만만치 않다. 핵심은 '환각(hallucination)' 문제다. LLM이 존재하지 않는 논문을 인용하거나, 실제로는 성립하지 않는 논리적 연결을 날조하는 현상은 여전히 해결되지 않았다. 과학 연구에서 이런 오류의 대가는 다른 어떤 영역과도 비교할 수 없다. 잘못된 가설에 기반한 실험은 수년의 시간과 수억 원의 연구비를 허공에 날린다.

한 HN 사용자의 지적이 날카롭다. "AI가 이 가설을 부활시킨 건 인상적이다. 하지만 이 가설이 10년 전에 폐기된 진짜 이유를 AI가 완전히 이해했는지는 별개의 문제다."

논문이 아니라 연구 시스템 전체가 흔들린다

논쟁에서 한 발 물러서면, Autoresearch가 던지는 진짜 질문이 보인다. 도구의 정확도가 아니다. 과학 연구의 생산 방식 자체가 바뀌고 있다는 시그널을 어떻게 읽을 것인가.

현재 학술 연구 시스템은 철저히 인간 중심으로 설계돼 있다. 연구비 심사, 동료 평가(peer review), 학술지 출판, 인용 지수. 이 모든 프로세스의 전제는 하나다. 사람이 가설을 세우고, 사람이 실험하고, 사람이 논문을 쓴다. AI가 이 사슬의 앞단, 가설 수립과 실험 설계, 을 맡기 시작하면, 뒷단의 프로세스도 연쇄적으로 재설계될 수밖에 없다.

투자자 시각에서도 주목할 만하다. AI 코딩 도구 시장은 이미 GitHub Copilot, Cursor, Replit이 격전을 벌이고 있고, 이미지 생성은 Midjourney와 Stability AI가 선점했다. 반면 '과학 연구 자동화'는 아직 확실한 승자가 없는 초기 시장이다. 잠재 고객은 전 세계 수백만 명의 연구자, 수만 개의 연구기관, 그리고 R&D 비용을 줄이려는 제약·소재·에너지 기업들이다. TAM(Total Addressable Market)은 충분히 크다.

반도체·배터리·바이오: 한국에 기회의 창이 열리는가

한국에서도 관련 움직임이 조용히 진행 중이다. KAIST와 서울대 연구팀들이 LLM 기반 논문 분석 도구를 개발하고 있고, 네이버와 LG AI Research도 과학 특화 모델에 관심을 보이고 있다. 한국이 강점을 지닌 반도체, 배터리, 바이오 분야에서 AI 연구 자동화 도구가 실질적 성과를 내기 시작하면, 도구 자체가 새로운 수출 상품이 될 가능성도 있다.

다만 현실적 제약이 분명하다. 고품질 한국어 학술 데이터의 부족, 연구 현장의 보수적 도입 문화, 그리고 "AI가 낸 아이디어로 쓴 논문이 내 논문인가"라는 학술 윤리 문제까지. 기술보다 제도와 인식이 느리게 움직이는 영역이다.

과학의 속도가 재설정되는 순간

10년 전 버려진 가설 하나가 AI의 손에서 되살아났다. 이 사실 자체가 논문 한 편의 가치를 지닌다. 과학 연구의 병목이 "아이디어의 부족"이 아니라 "아이디어를 검증할 시간과 자원의 부족"이었음을 실증한 셈이기 때문이다.

Autoresearch가 만능은 아니다. 환각 문제는 여전하고, 실험 설계의 현실 적합성도 별도의 검증이 필요하다. 그러나 방향은 분명하다. AI가 과학자의 일을 빼앗는 게 아니라, 과학자가 평생 탐색할 수 없었던 가능성의 공간을 여는 것. 서랍 속에 잠든 수백만 개의 가설이 다시 빛을 볼 수 있다면, 과학의 속도는 논문 출판 주기가 아니라 AI의 추론 속도에 맞춰 재설정될 것이다.

그 변화의 첫 페이지가, 지금 Hacker News의 댓글 창에서 쓰이고 있다.